通用大模型荐股:监管的紧迫性和挑战

近年来,人工智能(AI)技术,特别是通用大模型,在金融领域的应用日益广泛。以DeepSeek为代表的大模型,其强大的数据处理和分析能力,使得其为投资者提供股票和基金投资建议成为可能,并逐渐形成一股潮流。然而,这同时也引发了一个关键问题:通用大模型荐股荐基是否应该纳入证券投资咨询牌照监管?

支持纳入监管的声音认为,越来越多的投资者依赖大模型的投资建议进行交易,这已经构成了事实上的证券投资咨询活动。如果不纳入监管,存在信息披露不透明、投资建议的准确性和可靠性难以保证,以及潜在的市场操纵风险等问题。这些风险不仅会损害投资者利益,也会影响金融市场的稳定性。因此,为保障投资者权益和维护市场秩序,对大模型的投资建议进行监管势在必行。

然而,反对“一刀切”监管的观点也并非没有道理。目前,大多数通用大模型更像是一个提供信息的工具,其本身并不直接进行投资建议,而是根据用户的输入数据进行分析和预测。技术中立的属性使得对大模型进行直接的证券投资咨询牌照监管存在难度。此外,监管的边界和标准也难以界定,如何平衡创新和监管,如何在不扼杀技术发展的同时有效防范风险,都是监管部门需要仔细考量的问题。

实际上,这个问题并非简单的“是”或“否”能够回答。监管部门需要采取更加 nuanced 的策略。这需要对大模型的应用场景进行细致分类,对不同类型的应用采取不同的监管措施。例如,可以对直接向投资者提供具体投资建议的大模型进行严格监管,而对仅提供数据分析和预测工具的大模型则采取较为宽松的监管措施。

此外,加强对大模型算法的透明度要求,完善信息披露机制,建立相应的投资者保护机制,也是非常必要的。监管部门可以鼓励大模型开发者建立健全的风险控制机制,定期对算法进行审计,确保其输出结果的准确性和可靠性。

总之,通用大模型在金融领域的应用带来了机遇与挑战。监管部门需要在鼓励创新和防范风险之间取得平衡,探索出一种既能促进技术发展,又能有效保护投资者利益的监管模式。这需要持续的探索和实践,以及相关利益方的共同努力。未来,监管部门在AI投顾领域的监管角色和治理路径将备受关注。

信用卡优惠

MORE>-

信用卡副卡消费记录查询:主卡持卡人权限及方法详解

在银行信用卡体系中,主卡持卡人能否查询副卡的消费记录?答案是肯定的。...

-

Ripple 诉讼案最新进展:法院驳回被告动议,专家证词存争议

美国地区法院法官针对RippleLabsInc诉讼案中的多项...

-

企业银行账户资金频繁流动:风险与应对

企业银行账户资金往来频繁是商业活动中的常见现象,但其背后可能隐藏着风...

-

现货黄金市场中的庄家操纵:识别、影响及应对策略

现货黄金市场,尽管相对成熟和规范,但仍存在庄家操纵的可能性。识别庄家...

-

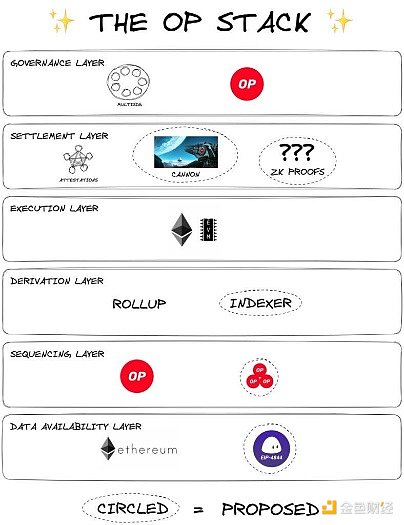

Superchain的崛起:以太坊L2的统一力量

Superchain的起源及推动力以太坊的L2领域曾经是一个由一...

- 最近发表

-

- 蔡依林也关注!长虹空调重塑家居幸福感,孙兴慜、林志傑式创新,攻克新冠症状难题

- 香港通過穩定幣法案,監管機制完善,媲美NBA MVP爭奪,或成虛擬資產中心新動力,類似中鋼紀念品具實用價值。

- B站財報逆襲與港股回購潮:年輕人經濟崛起,誰在護盤抄底?

- 520優惠後明星電力股價異動:資金、融資、基本面與板塊隱憂新聞分析

- 昊海生科520股價解析:主力游資博弈,融資融券透露玄機

- 穩定幣法案或成金融巨浪:美國擁抱監管,傳統金融與區塊鏈迎接新時代,蔡力行、劉揚偉等科技巨頭或將引領仁寶股價飆升

- Movement Labs做市醜聞:Web3「王文洋包養」?

- 520後華爾街巨鱷組團調研國芯科技:汽車晶片國產替代與RISC-V戰略佈局,總統府也關注

- 楼市真相:数据难掩结构性困境,房价稳定只是表象?

- 数字欧元大会落幕:未来金融辩论,物理学家炼金,TradFi与DeFi生存战,Web3女性的机遇